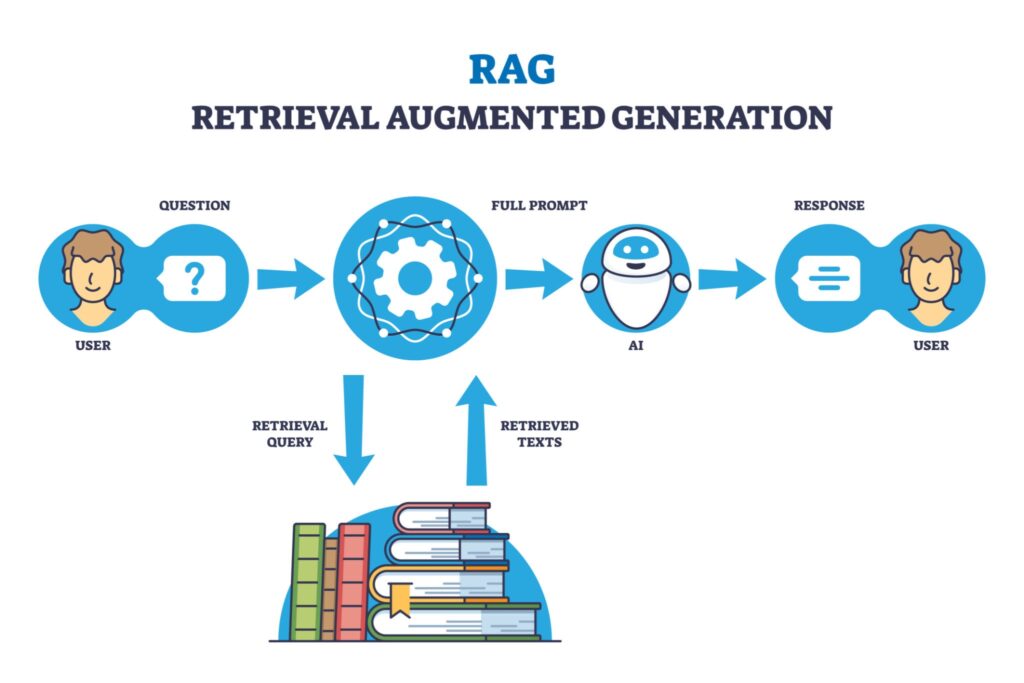

Para transformar seu computador em uma central de inteligência privada, vamos focar no uso do Ollama para rodar o modelo e no LM Studio para o treinamento fino (Fine-tuning) ou uso de RAG (Geração Aumentada por Recuperação), que é a forma mais eficiente de “alimentar” a IA com seus dados.

Aqui está o guia técnico para configurar seu modelo local:

1. Requisitos de Hardware

Antes de começar, certifique-se de que seu sistema aguenta o processo:

- GPU: Mínimo de 8GB de VRAM (NVIDIA série 30 ou 40 é o ideal).

- RAM: 16GB (mínimo) ou 32GB (recomendado).

- Armazenamento: SSD com pelo menos 20GB livres para os modelos.

2. Passo a Passo: Instalação e Configuração

Passo A: Instalando o “Motor” (Ollama)

O Ollama é a ferramenta mais simples para rodar modelos como Llama 3 ou Mistral localmente.

- Acesse ollama.com e baixe a versão para seu SO (Windows/Mac/Linux).

- Abra o terminal (ou CMD) e digite:

ollama run llama3. - O download começará automaticamente e, ao final, você já terá uma IA rodando offline.

Passo B: Alimentando com seus Dados (RAG Local)

Para a IA “ler” seus arquivos (PDFs, TXTs, Docs) sem precisar de programação complexa:

- Baixe o AnythingLLM ou GPT4All.

- Nas configurações, aponte o “Provider” para o Ollama que você instalou.

- Crie um “Workspace” e faça o upload da sua pasta de dados (seus artigos, notas, livros).

- A IA criará um Vector Database local. Agora, ao perguntar algo, ela consultará seus documentos primeiro.

Passo C: Fine-Tuning (Opcional e Avançado)

Se você quer que a IA aprenda seu estilo de escrita e não apenas consulte fatos, você precisa de um “Fine-tuning” via LoRA (Low-Rank Adaptation):

- Use o LM Studio para baixar um modelo “GGUF”.

- Prepare um arquivo JSONL com exemplos de:

{"instrução": "pergunta", "resposta": "sua escrita real"}. - Utilize uma ferramenta como Unsloth (via Google Colab ou localmente com Python) para treinar o modelo sobre a base original.

3. Checklist de Ética Técnica

- Limpeza de Dados: Antes de treinar, remova CPFs, senhas ou dados sensíveis de clientes dos seus arquivos.

- Selo de Origem: No seu blog, use um metadado ou nota de rodapé: “Conteúdo otimizado por IA local treinada em base proprietária; revisão e curadoria final por [Seu Nome]”.

- Update de Base: Modelos locais ficam obsoletos. Repita o processo de alimentação de dados a cada 3 meses para manter a IA atualizada com seus pensamentos novos.

Resumo dos Comandos Úteis (Terminal)

ollama list(Ver modelos instalados)ollama rm [nome](Remover modelo para liberar espaço)ollama serve(Manter o motor rodando para aplicativos externos)